FramamIA

Comprendre l'IA pour la démystifier

1. L'IA c'est technique, donc politique !

Ni apocalyptique, ni récent

De Shakey the robot (premier robot qui raisonne sur ses actions, Stanford, 1966) à ChatGPT en passant par Clippy (l'assistant de Microsoft Office 97)... l'Intelligence artificielle a plus de 70 ans d'histoire.

Voire plus encore : nos cultures ne manquent pas de mythes et symboles où la magie permet d'humaniser des machines. La légende du Golem, Edward aux mains d'argent, l'emoji ✨ désignant l'IA dans la tech…

Présentée simultanément comme la baguette magique qui va sauver la terre et comme la boite noire qui va asservir l'humanité, l'IA désigne pourtant, aujourd’hui, un domaine technique du numérique.

Comprendre pour choisir collectivement

Or derrière chaque outil technique, il y a un contexte idéologique et des choix politiques, qui peuvent transformer l’organisation de nos sociétés.

Aujourd'hui, ces choix sont monopolisés par de grandes entreprises dont le discours grandiloquent mystifie, sidère, envoûte... nous ôtant la capacité de s'emparer du sujet et questionner les choix.

L'objectif de ce site est de partager des clés de compréhension sur ce qu'est l'IA aujourd'hui, des enjeux que ce domaine du numérique pose à nos sociétés et enfin des questions à se poser pour déterminer si tel outil est digne de notre confiance.

Mème Clippy « avez-vous besoin d'aide pour déclencher l'apocalypse ? »

Ce n'est pas l'IA que vous détestez, c'est le capitalisme !

Ce n'est pas l'IA que vous détestez, c'est le capitalisme !

2. Mieux comprendre l'IA

2.1 L'IA c’est quoi ?

Pour définir ce qu'on entend aujourd'hui par « intelligence artificielle », on peut se référer à la définition qu'en donne le Parlement Européen :

« possibilité pour une machine de reproduire des comportements liés aux humains, tels que le raisonnement, la planification et la créativité ».

Du code et des maths

L’IA est un vaste domaine rassemblant « une famille de technologies et de méthodes mathématiques (des algorithmes) qui vise à permettre à des machines de simuler ou de s’inspirer des processus cognitifs des êtres humains (apprentissage) pour réaliser des tâches ». Ces tâches sont la représentation du savoir, la résolution de problèmes, la compréhension, la perception (vision, ouïe), la planification et la prise de décision, la communication et la production de contenus.

Dans nos vies

L'IA touche d'innombrables aspects de notre vie quotidienne et passe souvent complètement inaperçue pour celles et ceux qui n'ont pas une compréhension ou une conscience profonde de la technologie et de la façon dont elle est mise en œuvre : assistants numériques (chatbots, dont ChatGPT), assistants vocaux, recommandations personnalisées sur les sites e-commerce et de streaming, guidage GPS et enceintes connectées sont des exemples de l’IA utilisés dans notre quotidien.

Google Home, vu par Gee (CC BY-SA)

2.2 Comment ça marche ?

L'IA aujourd'hui en France

Au quotidien

Selon un sondage de février 2023, 36 % des Français·es trouvent que l'IA est un concept flou. Néanmoins, parmi les sondé·es, beaucoup l'utilisent déjà, en particulier pour la traduction.

En entreprise

Dans les entreprises aussi, l’IA est de plus en plus utilisée : fin 2024, on estime que 30 à 40 % des entreprises françaises utilisent ou créent des IA. L’étude Hopes and Fears 2024 de PwC montre que 48 % des salariés français ont déjà utilisé une IA générative dans leur cadre professionnel et qu'ils sont déjà 21 % à l'utiliser au moins une fois par mois.

Selon l'activité

Les usages de l'IA varient en fonction du secteur d'activités : si les entreprises technologiques l'ont fortement intégrée (88 %), c'est un peu moins le cas dans d'autres secteurs.

2.3 Pas une IA mais des IA

IA spécialisée

IA polyvalente

2.4 Les grandes familles d'IA

3. Impacts d'une IA capitaliste

3.1 L'IA, une économie comme les autres ?

Capitalisme algorithmique

Avec les innovations récentes (IA générative, etc.), on observe l'émergence du capitalisme algorithmique. Il repose sur l’extraction massive de données personnelles, le développement accéléré d’algorithmes, l’hégémonie des plateformes, une refonte du monde du travail et l’arrivée de systèmes décisionnels automatisés dans nos sphères sociales. L’IA est une industrie de la rentabilité : elle vise à réduire les coûts partout où c'est possible, afin de générer de nouveaux monopoles économiques.

Bulle financière

L'IA nécessite des investissements gigantesques en infrastructure. Pensée par les géants de la tech comme une autre source de profits, on ne sait toujours pas comment ils comptent gagner de l'argent. Des start-up (Inflection AI, Character AI, Adept AI, etc.), ont aussi intégré le secteur, via des investissements massifs. Faute de modèle économique viable, elles perdent leurs investisseurs et peinent à assurer les coûts d’entraînement et d’inférence des modèles d’IA.

Un marché juteux

Le marché de l'IA représentait 241 milliards de dollars en 2023 : l'impact de son essor sur l'économie reste à identifier. En 2024, le marché de l’infrastructure (cartes graphiques, serveurs, etc.) est estimé à 68,46 milliards USD. Nvidia (producteur de semi conducteurs aux USA) a ainsi vu son CA augmenter de 125,85 % et sa valorisation dépasser les 3.000 milliards USD. Nvidia détient 90 % du marché des composants qui font fonctionner les IA génératives, mais ne peut pas suivre le rythme des commandes.

3.2 Extractivisme, pillage et appropriation

Nos posts en pâture

« J'accepte tout »

Chalutage du web

Travail du clic

Affiche du documentaire Invisibles - les travailleurs du clic

Terres rares et lointaines

Exploiter les ressources avec un minimum de soin pour un maximum de profits… ces mécanismes de pillage et d’appropriation s'appuient sur les idéologies (néo)coloniales. Ils sont inhérents au capitalisme algorithmique.

3.3 Une industrie écocide

Mesurer l'impact

Métaux et minerais

Artificialisation des sols

Des besoins énergétiques mal anticipés

Usine de cartes graphiques Nvidia, utilisées notamment pour faire fonctionner des IA génératives. - © pcgamesn.com

4. Risques culturels et démocratiques

4.1 Reconfiguration du monde du travail

Réduire les emplois ou faciliter le travail ?

Près de 40 % des emplois dans le monde sont déjà exposés à l’IA dans les pays occidentaux. Les grandes entreprises qui intègrent l’IA privilégient massivement l’automatisation (remplacer les personnes) à l’augmentation (rendre les personnes plus productives), en visant une rentabilité à court terme. La moitié des emplois exposés pourrait bénéficier de l’intégration de l’IA, qui se traduirait par un gain de productivité.

Les secteurs professionnels déjà impactés

L’IA se démarque par sa capacité à toucher les emplois hautement qualifiés, comme par exemple dans : la santé (médecine préventive, CIAO), la finance et la banque (détection des fraudes, économies d'échelle), le commerce de détail (gestion des stocks), l'industrie manufacturière (optimisation des chaînes de production), les transports et la logistique (véhicules autonomes, gestion du trafic), l'informatique (révision et la sécurisation du code), l'éducation (contenus éducatifs), etc.

Un avenir d'inégalités accrues

L’IA va influer sur les inégalités de revenus (et de richesses) en créant un phénomène de polarisation où les travailleur⋅ses qui seront capables d’exploiter l’IA verront leur productivité et leur salaire augmenter, contrairement à celles et ceux qui ne sauront pas le faire. De plus en plus de travailleurs non-qualifiés seront relégués à des emplois de service mal rémunérés où une présence humaine est encore nécessaire, tels que ceux d’aide-soignant, d’assistante maternelle ou de portier.

Publicité « arrêtez d'embaucher des humains » diffusée autour de San Francisco et promouvant le bot de rendez-vous commerciaux de Artisan AI (Crédits de l'image : /u/jasparcjt via Reddit)

4.2 Des bouleversements culturels

La culture des monopoles

Tropes et clichés

Développement de l'individualisme

Biais, deepfakes et infopollution : des conséquences concrètes

Affiche du documentaire CodedBias : Algorithmes et discriminations.

4.3 Confiscation des choix démocratiques

Un idéal démocratique malmené

Une démocratie technique inexistante

« Erreur 404 - Démocracie non trouvée » Source : Observatoire de la Dette dans la Globalisation (odg.cat)

En complexifiant un peu plus l’environnement numérique dans lequel nous évoluons, l'IA va conforter, voire amplifier, la fracture numérique actuelle qui touche déjà 15 % de la population française.

5. Choix d'outil, choix de société

5.1 Collectivement, exiger l'éthique

Progresser... vers quoi ?

Posséder l'intelligence ?

Faire plus, faire mieux ?

5.2 Individuellement, questionner l'acceptable

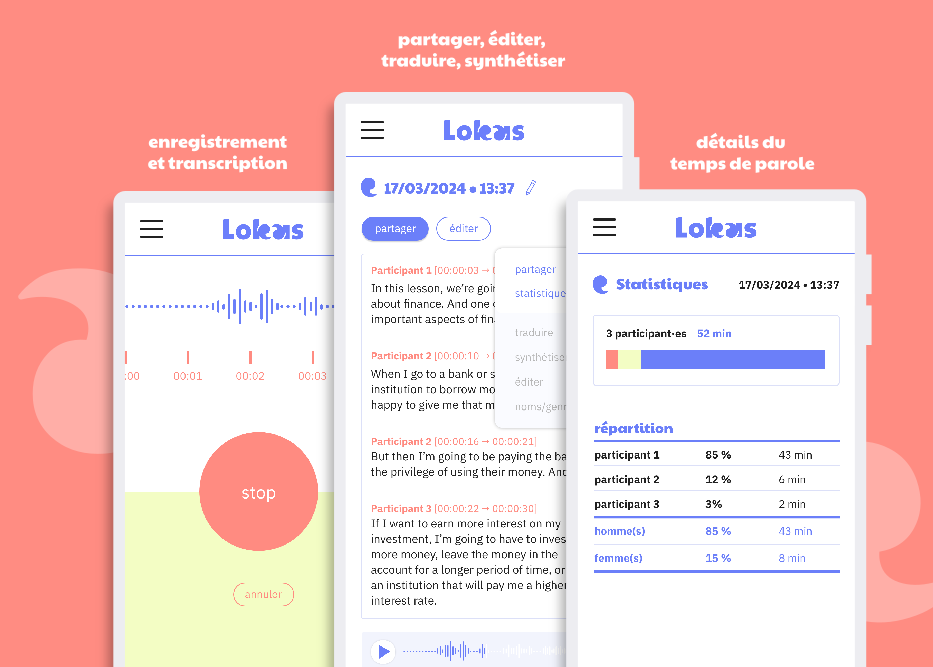

5.3 L'expérimentation de Framasoft : Lokas

Lokas est une démonstration (un prototype) d'outil IA conçu par Framasoft. Nous avions envie de voir quelle forme prendrait un outil fait par une association sans but lucratif et aux moyens limités, souhaitant être utile au bien commun, en transparence et en limitant l'impact.

Lokas est une application mobile (Android et iOS) qui permet d'enregistrer une réunion, afin d'obtenir un transcript. Cette démo est limitée, mais fonctionnelle : à vous de nous dire s'il faut poursuivre l'exploration !

6. Pour aller plus loin

Who is behind Framamia?

Framamia is proposed by a French not-for-profit association: Framasoft

Created in 2004, the association is now dedicated to popular education on the challenges of the digital age and the cultural commons. Our small structure (35 including 10) is known the De-google-ify Internet project (26 ethical and alternative online tools) and for the development of projects like PeerTube. Recognized as being of general interest Framasoft is funded at 94% by your donations, which are tax deductible for French taxpayers.

Support Framasoft

Because freedom doesn’t mean it’s free…

Framasoft is a not-for-profit which can only keep running thanks to your donations. Do you like what we do? Do you think we’re going in the right direction? If so, and you’re able to make a donation, we’d very much appreciate it!

Questions

- Recurring donations can be stopped anytime, just ask us.

- If you want to modify your recurring donation, please contact us, we will stop the current one and you will be able to make a new one.

- Tax receipts (in France only) are sent by postal mail in March/April 2027 (before tax declaration) for 2026 donations

- Financial and activity reports can be found on the not-for-profit page

- If you have more questions, you may find answers there…

Illustration : David Revoy (Creative Commons By 4.0)